Natürlich nicht. Dennoch hätte ich erwartet, dass sich da in zehn Jahren deutlich mehr getan hätte.

Vergleiche dagegen mal 2000 bis 2010.

Das Problem ist wohl, dass "wir" gegen die physikalische Mauer laufen, 5 GHz , Leistungsverdoppelung alle 18 Monate ("Mooresches Gesetz"), Verdoppelung der Schaltkreisdichte funktioniert nicht mehr, dagegen kommt man nach bisheriger Kenntnis ein wenig mit Verdoppelung der Kerne an wobei wir wieder bei der Aufteilung und Zusammenführung über alle Kerne wären - eine Verdopplung der Zahl der Kerne führt mitnichten zu einer Verdoppelung der Rechenleistung!

Bis 2015 ließ sich die Dichte durch Verkleinerung der Strukturen erreichen, dann war die Dichte so klein, dass dies eben nur mit riesigen Problemen möglich scheint - Intel schafft den 7nm Prozess bisher nicht befriedigend (zu teuer, zu fehleranfällig, nicht energieeffizient…), viele prognostizierten noch 10 Jahre, einige Mutige sprachen von 2030, aber bei nennenswerten Stückzahlen sind die Hürden extrem, Prototypen gibt es auch schon bis 5nm, allerdings ist der Leistungsgewinn viel zu klein. Es gibt wohl ein konzeptionelles Dilemma der bisherigen Technik.

28 Kerne im neuen MacPro laufen eben langsamer, mehr führt dann irgendwann dazu, dass die Leitungswege länger, oder zu lang werden. Der Turboboost einzelner Kerne verkompliziert (und verteuert dramatisch) die Konstruktion, also gibt es Grenzen (Finanzierbarkeit). lor-olli ist ein alter Sack und fing in den frühen 80er Jahren mit dem Computer an, der Optimismus war grenzenlos, aber so wie es aussieht erlebe ich sogar noch das limit dieser Technik (Taktraten) - ob Quantenrechner einen Neustart bedeuten ist noch nicht sicher, insofern ist die Leistung die in einen Desktop der Größe eines MacPro gepackt wurde schon beeindruckend. Wie sich zeigt kann man in Abhängigkeit der Aufgaben durchaus noch mit einigen Kniffen Leistungsschübe erzielen (Afterburner Karte die beim Codieren die CPU enlastet), in der Summe wird es dann allerdings teuer…

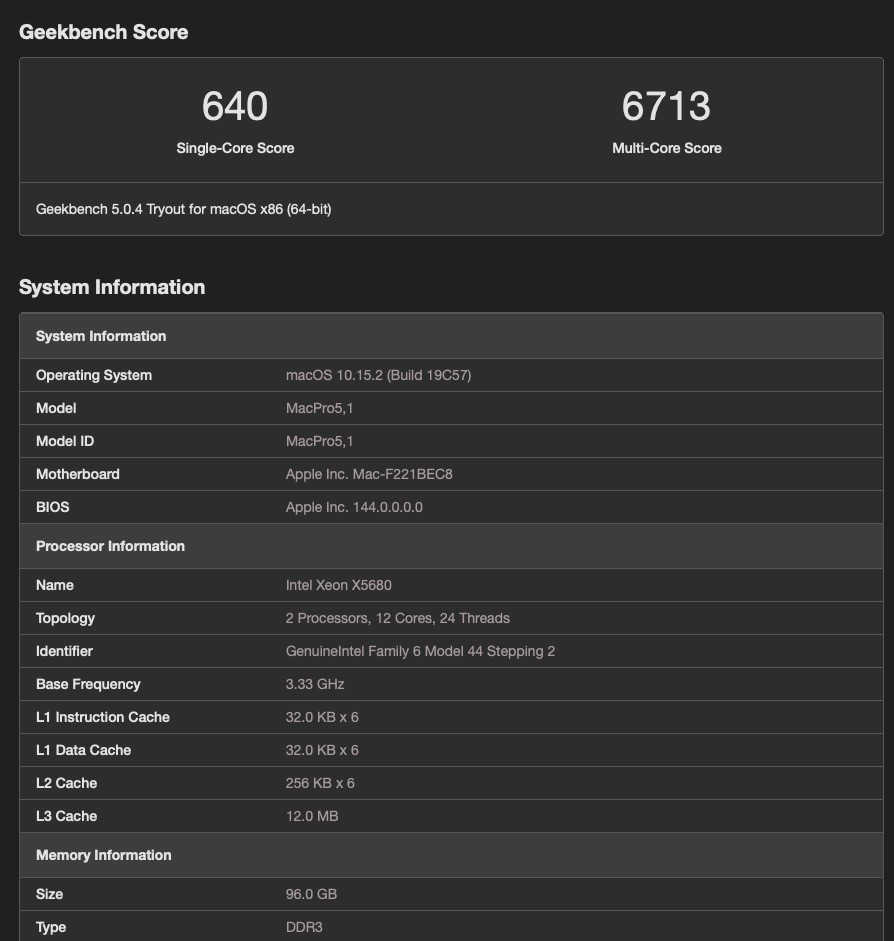

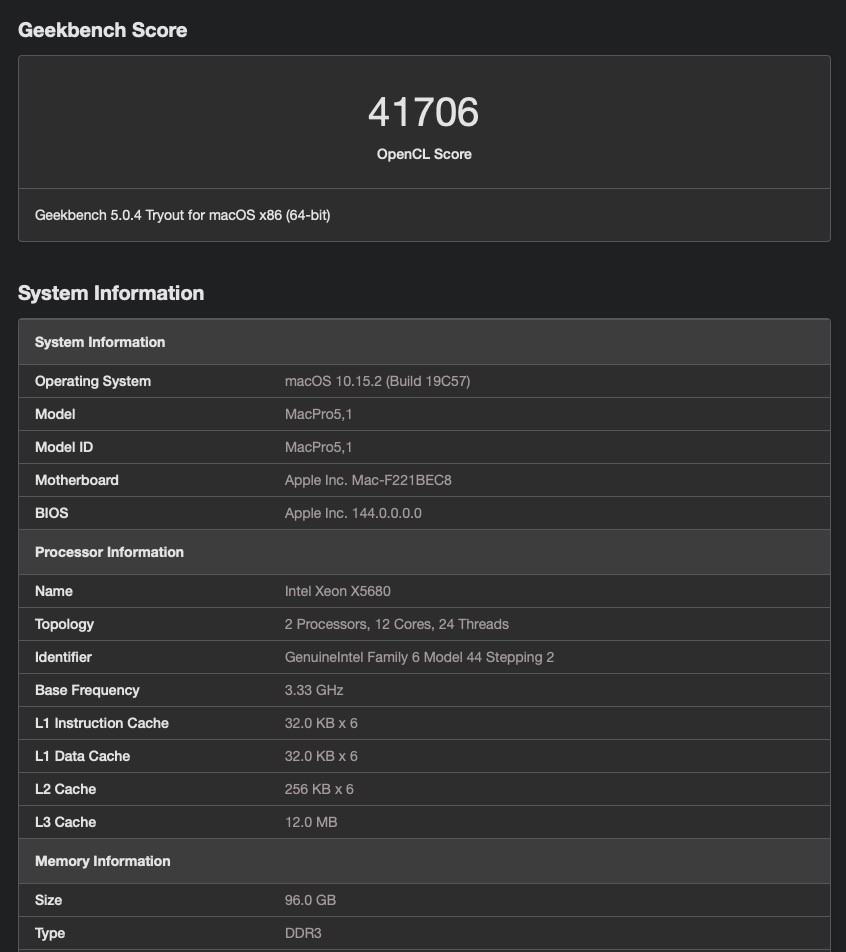

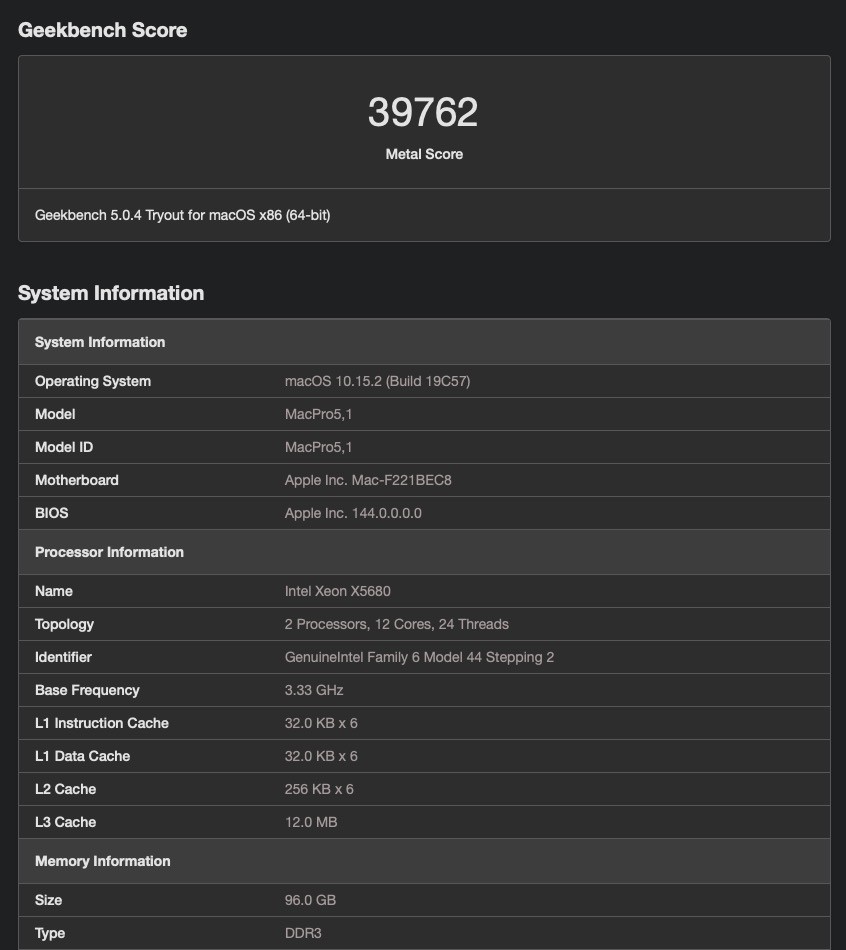

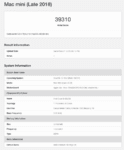

Ich bin gespannt, wann die ersten Alltagstests mit bekannten, vergleichbaren Aufgaben erscheinen, reine benchmarks habe ich schon lange skeptisch angesehen, die sind nur relevant wenn ein Rechner eine einzige Aufgabe immer wiederholt und nicht verschiedene Aufgaben abarbeitet.

Bei gutem workflow sind nominell schwächere Rechner nicht unbedingt langsamer, wir User werden immer mehr zur Bremse für den Rechner